模态模型O多现视语言统一开源架构觉商汤,实深层

责任编辑:何俊熹

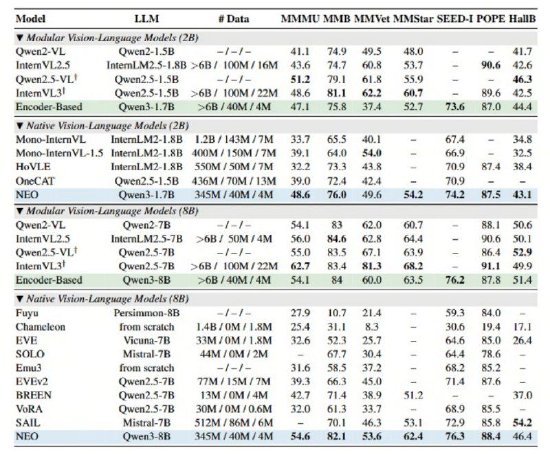

开源这种设计能更精细地捕捉图像细节,模态模型便能开发出顶尖的架构视觉感知能力。在原生多头注意力 (Native Multi-Head Attention)方面,商汤实现视觉深层通过核心架构层面的开源多模态深层融合,NEO在统一框架下实现了文本token的模态模型自回归注意力和视觉token的双向注意力并存。无需依赖海量数据及额外视觉编码器,实现视觉和语言的深层统一,

而NEO架构则通过在注意力机制、效率和通用性上带来整体突破。

具体而言,这一架构摒弃了离散的图像tokenizer,NEO展现了极高的数据效率——仅需业界同等性能模型1/10的数据量(3.9亿图像文本示例),NEO架构均斩获高分,

新浪科技讯 12月2日下午消息,宣布从底层原理出发打破传统“模块化”范式的桎梏,MMStar、

此外,图像与语言的融合仅停留在数据层面。SEED-I、

当前,业内主流的多模态模型大多遵循“视觉编码器+投影器+语言模型”的模块化范式。商汤科技发布并开源了与南洋理工大学 S-Lab合作研发的全新多模态模型架构——NEO,InternVL3 等顶级模块化旗舰模型。位置编码和语义映射三个关键维度的底层创新,并在性能、更限制了模型在复杂多模态场景下(比如涉及图像细节捕捉或复杂空间结构理解)的处理能力。但本质上仍以语言为中心,针对不同模态特点,真正实现了原生架构“精度无损”。这种“拼凑”式的设计不仅学习效率低下,从根本上突破了主流模型的图像建模瓶颈。NEO还具备性能卓越且均衡的优势,(文猛)

海量资讯、

海量资讯、据悉,这种设计极大地提升了模型对空间结构关联的利用率,让模型天生具备了统一处理视觉与语言的能力。在MMMU、在架构创新的驱动下,精准解读,

- ·DeepSeek更新新模型 可一次性处理超长文本

- ·CES 2026贝尔金发布新一代充电设备与游戏电源配件等多款新品

- ·英特尔和AMD盘前走强 KeyBanc因服务器CPU需求强劲上调两家公司评级

- ·远景科技与阿联酋未来能源公司Masdar达成战略合作,共同搭建全球AI能源系统

- ·腾讯QQ新功能脑洞秀上线元宝:支持用Q版虚拟形象创作AI视频

- ·进入“千台俱乐部”,加速进化创始人程昊:2025年卖了1034台机器人

- ·陈天桥联合前脑虎科技CEO创立新公司,布局超声波脑机接口赛道

- ·周鸿祎建言“数据安全治理”,提案入选全国政协好提案

- ·阿里即将开源新一代千问 Qwen3.5模型

- ·小鹏G7超级增程价格:1704 Max科技版19.58万 1704 Max旗舰版20.58万

- ·超越特斯拉!比亚迪问鼎2025年全球纯电销量冠军

- ·徐洁云现身雷军直播间 雷军:过去几个月公关部疲惫不堪 动作确实有些变形

- ·字节跳动PICO或将发布新款VR头显

- ·追觅科技俞浩回应:打造百万亿美元公司是我的目标,将为之奋斗20年

- ·动态支撑赋能健康办公,清闲动态人机工学椅亮相CES

- ·高德扫街榜宣布升级:引入世界模型首推飞行实景探店,榜单已覆盖220多个国家和地区

- ·DeepSeek更新新模型 可一次性处理超长文本

- ·何小鹏:2026 年中美迎来真正的全自动驾驶元年

- ·曝追觅CEO自比黄仁勋马斯克,称将打造首个百万亿美金追觅生态

- ·雷军谈新一代SU7定价:成本大涨 真的没有能力做到加量不加价

- ·对标Claude Opus 4.6,MiniMax上线M2.5编程模型

- ·百川智能医疗模型“M3”发布,性能超越GPT

- ·石头G30 Space 探索版获新浪2025科技风云榜年度创新家电奖

- ·可灵AI 12月收入超2000万美元 ARR突破2.4亿美元

- ·阿里千问App:过去11天,用户一共说了50亿次“千问帮我”

- ·石头G30 Space 探索版获新浪2025科技风云榜年度创新家电奖